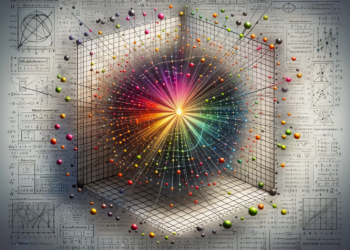

La función de pérdida, un pilar fundamental en el diseño y optimización de modelos de aprendizaje automático, se alinea directamente con la exactitud cualitativa de las predicciones. Esta medida cuantitativa representa la discrepancia entre las salidas previstas por el modelo y los valores reales; su minimización es clave en el objetivo de refinar y potenciar los algoritmos de aprendizaje.

Evolución histórica de las Funciones de Pérdida

Iniciando con el Perceptrón y el advenimiento del algoritmo de retropropagación, las funciones más primitivas acentuaban la simplicidad sobre la precisión. Sin embargo, con cada era en el desarrollo de la inteligencia artificial, estas funciones han evolucionado. La migración desde el error cuadrático medio (MSE, Mean Squared Error) hasta el Entropía Cruzada Binaria en contextos de clasificación binaria, y la introducción de la Softmax Loss para escenarios de clasificación múltiple, ejemplifican esta progresión. Este avance responde a la creciente complejidad de las arquitecturas y la diversidad de las problemáticas abordadas.

Aspectos Técnicos Avanzados y Recientes

Funciones de Pérdida Adaptativas y Basadas en Contexto

Las funciones de pérdida adaptativas, tales como la Loss Focal y la Tversky Loss, incorporan métricas de comportamiento en escenarios desbalanceados y focalizan el aprendizaje en ejemplos más difíciles, contrarrestando el desequilibrio y dominancia de clases prevalentes. Estas funciones recalculan dinámicamente los pesos asignados a cada muestra durante el entrenamiento permitiendo una convergencia rápida y eficaz.

Aprendizaje Profundo y Funciones de Pérdida Compuestas

Algoritmos de aprendizaje profundo emplean funciones compuestas que intencionan solucionar múltiples objetivos simultáneamente. Por ejemplo, en redes generativas antagónicas (GANs, Generative Adversarial Networks), se combina una función que promueve la autenticidad de las imágenes generadas con otra que fomenta la discriminación precisa de ejemplares auténticos frente a los falsos.

Regularización y Sensibilidad a la Distribución de Datos

Más allá de la función de pérdida estándar, el término de regularización como Lasso (L1) y Ridge (L2) puede integrarse para inducir modelos menos propensos al sobreajuste. Enfoques recientes proponen funciones que toman en cuenta la distribución inherente de los datos, orientando los parámetros del modelo hacia soluciones más generales y robustas.

Aplicaciones Prácticas Surgiendo

El impacto de las funciones de pérdida se magnifica en aplicaciones del mundo real. En el campo de la visión por computadora, por ejemplo, el IoU (Intersection over Union) Loss se ha utilizado para mejorar la precisión en tareas de localización y segmentación de objetos. En el área del procesamiento del lenguaje natural, funciones especializadas como la Connectionist Temporal Classification (CTC) Loss han sido cruciales para los modelos de reconocimiento de voz, permitiendo un aprendizaje efectivo sin la necesidad de alinear previamente los datos de entrada con sus transcripciones.

Comparación con Trabajos Anteriores y Proyección a Futuras Direcciones

La comparativa de funciones de pérdida es instrumental para el entendimiento de su evolución y pertinencia. Por ejemplo, el reemplazo de MSE por Cross-Entropy en clasificadores ha demarcado un hito, atribuido a la eficacia de esta última en la gestión de errores en clasificaciones probabilísticas. Analizando metódicamente los avances, se proyecta que las funciones de pérdida serán cada vez más especializadas y adaptativas, refinando su capacidad para abordar desafíos específicos.

La exploración de funciones de pérdida híbridas y su sinergia con métodos de optimización como Adam y RMSprop es tendencia. Además, la inteligencia artificial emergente posiblemente convergerá hacia el principio de una ‘pérdida mínima satisfactoria’, donde no se busque únicamente la minimización, sino una convergencia que priorice también la comprensión, explicabilidad y fiabilidad del modelo.

Conclusiones

Las funciones de pérdida emergen como un componente crítico que no solo dirige el aprendizaje de los modelos, sino que también refleja la complejidad y diversidad de las aplicaciones contemporáneas en inteligencia artificial. La vanguardia de la investigación se enfoca en desarrollar estos instrumentos matemáticos, para que sean cada vez más afinados y contextuales, marcando así el ritmo del progreso en la creación de modelos más avanzados y aplicables a problemas reales.

Con la continua exploración y desarrollo que caracteriza a la disciplina de la inteligencia artificial, se espera que las funciones de pérdida se conviertan en ejes aún más sofisticados y multidimensionales, ofreciendo profundidad y flexibilidad para los desafíos futuros que se planteen en esta área apasionante y en constante evolución.