Las Redes Neuronales Convolucionales (CNNs) emergieron dentro del ámbito del Aprendizaje Profundo (Deep Learning), constituyendo una evolución directa de perceptrones multicapa destinados al procesamiento de datos en dos dimensiones. Inspiradas por la estructura del córtex visual de los seres vivos, revelaron la capacidad de realizar aprendizaje automático especializado en reconocimiento de patrones visuales. Desde sus antecesores como LeNet-5, diseñado por Yann LeCun en 1998, las CNNs han ampliado su dominio en el procesamiento de imágenes, superando en eficacia a métodos precedentes basados en extracción manual de características.

Fundamentos Técnicos de las CNNs

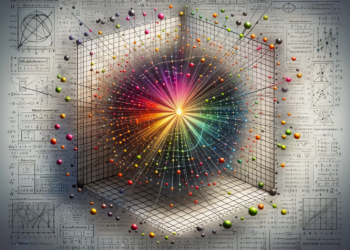

Las CNNs distinguen por incorporar capas convolucionales donde filtros entrenables efectúan convoluciones sobre datos de entrada, facilitando la detección de características locales. Posteriormente, las capas de agrupamiento (pooling) reducen la dimensionalidad espacial, mejorando la robustez frente a variaciones y disminuyendo la complejidad computacional. Una secuencia de capas totalmente conectadas actúa sobre representaciones altamente abstractas para ejecutar clasificaciones o regresiones. A través de mecanismos como la Retropopagación (Backpropagation) y el Descenso del Gradiente Estocástico (SGD), las CNNs optimizan sus pesos y sesgos internos en un proceso denominado entrenamiento.

Avances Recientes en Algoritmos

Durante la última década, innovaciones algorítmicas han propulsado notablemente el desempeño de las CNNs. La introducción de funciones de activación ReLU (Rectified Linear Units) mejoró la velocidad de convergencia en el entrenamiento. Igualmente significativo fue el desarrollo de técnicas de regularización como Dropout y Batch Normalization, esenciales para combatir el sobreajuste y acelerar la convergencia. Asimismo, la adopción de metodologías como la Inicialización de He y la Optimización de Adam, han perfeccionado aún más la eficiencia en el entrenamiento de CNNs profundas.

Despliegue Aplicado de CNNs

En la praxis, las CNNs han revolucionado múltiples campos. Aplicaciones impulsoras incluyen la visión por computador, con logros en la detección y reconocimiento de objetos. Un estudio de caso prominente reside en la implementación de CNNs en sistemas de conducción autónoma, donde redes como PilotNet de NVIDIA, analizan flujos visuales para tomar decisiones de conducción en tiempo real. Otro ámbito disruptivo es el diagnóstico médico asistido, donde CNNs como Inception v3 han demostrado superar especialistas humanos en la precisión de diagnósticos a partir de imágenes médicas.

Comparativa y Evolución de Arquitecturas

Un repaso histórico revela una evolución desde modelos simplistas a arquitecturas complejas, multicapas, y capaces de capturar patrones jerárquicos en los datos. La progresión de AlexNet a arquitecturas como ZFNet, GoogleNet, y ResNet, entre otros, refleja un desarrollo constante. El análisis comparativo destaca que la profundización en capas ha sido crucial, pero también lo ha sido la innovación en mecanizados de ensamble y conexiones residuales, fundamentales para el entrenamiento efectivo de redes ultra-profundas.

Desafíos y Proyección Futura

A pesar de los logros alcanzados, las CNNs enfrentan desafíos sustanciales. La eficacia depende de vastos volúmenes de datos anotados y un alto costo computacional, lo que incita a la investigación en aprendizaje no supervisado y transferencia de aprendizaje. Adicionalmente, la interpretabilidad de los modelos CNN continúa siendo una línea de indagación esencial, habida cuenta de la necesidad de comprensión y justificación de las decisiones automáticas.

Futuras direcciones apuntan hacia la integración de CNNs con otras formas de inteligencia artificial, como los mecanismos de atención y las Redes Generativas Adversarias (GANs), ampliando sus aplicaciones hacia la generación de contenido y el procesamiento de lenguaje natural. Un escenario emergente es la implementación de CNNs en plataformas edge, que demandan arquitecturas eficientes en memoria y cálculo como MobileNets y EfficientNets.

Conclusiones

Las Redes Neuronales Convolucionales son una pieza angular del Aprendizaje Profundo, evolucionando de simples perceptrones a estructuras altamente especializadas y eficaces, demostrando una capacidad transformadora en el procesamiento de información visual. La continua mejora de su diseño y aplicación augura un panorama donde su influencia en la tecnología y la ciencia será aún más penetrante y vanguardista, estableciendo un hito clave en la ruta hacia la inteligencia artificial avanzada.